Wissen. Technik. Kreativität.

Google Gemini 3 Flash: Neues KI-Modell für Entwickler veröffentlicht, kommt aber auch in die App

Google hat mit Gemini 3 Flash ein neues, schnelles KI‑Modell veröffentlicht, das Entwicklern über die Gemini‑API/Vertex AI zur Verfügung steht und gleichzeitig als Standard‑Modell in der Gemini‑App ausgerollt wird.

Was Gemini 3 Flash ist

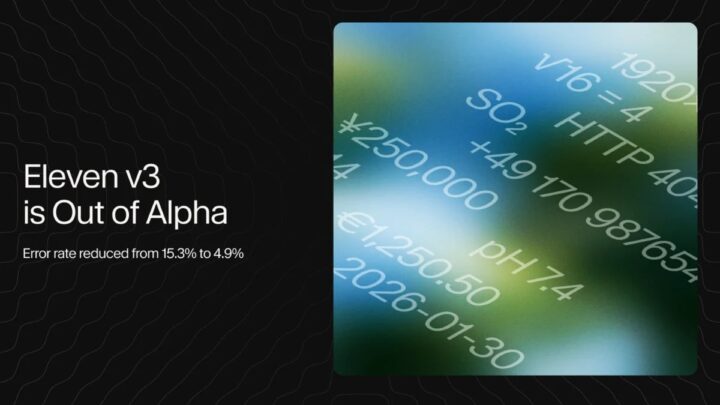

Gemini 3 Flash ist ein „frontier“-Modell, das die Reasoning‑Fähigkeiten von Gemini 3 Pro mit der Geschwindigkeit und Effizienz der Flash‑Reihe kombiniert. Es soll in Benchmarks 2.5 Pro bei ähnlicher Qualität deutlich übertreffen, dabei bis zu dreimal schneller reagieren und rund 30% weniger Tokens in typischen Workloads verbrauchen.

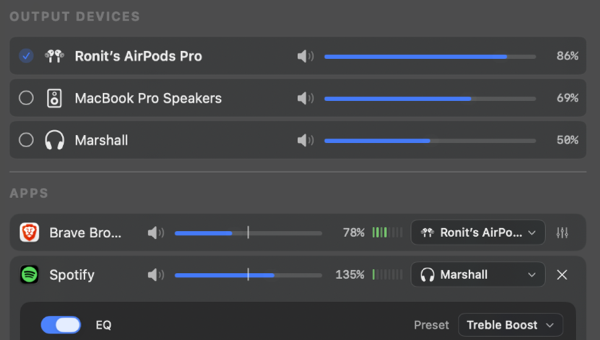

Das Modell ist voll multimodal: Es verarbeitet Text, Bilder, Audio und Video, kann also z.B. Screenshots, Skizzen, kurze Clips oder Audioaufnahmen analysieren und darauf basierend antworten. Google positioniert es als „Workhorse“-Modell für Agenten, Coding‑Assistenten, Datenextraktion, Videoanalyse und interaktive Anwendungen mit hoher Anfragenfrequenz.

Einsatz in der Gemini-App

In der Gemini‑App ersetzt Gemini 3 Flash das bisherige 2.5 Flash als Standardmodell („Fast“/„Thinking“), sowohl in der App selbst als auch im AI‑Mode von Google Search. In der Modell‑Auswahl erscheinen jetzt:

- „Fast“ / „Thinking“: Gemini 3 Flash in zwei Betriebsarten – schnelle Antworten bzw. tieferes Nachdenken für komplexere Fragen.

- „Pro“: Gemini 3 Pro für besonders anspruchsvolle Mathe‑, Code‑ und Spezialaufgaben.

Für Nutzer bedeutet das: schnellere Antwortzeiten, bessere Verständnisleistung bei multimodalen Anfragen (z.B. Fotos, UI‑Screenshots, Notizzettel) und mehr visuelle Ausgaben wie Tabellen und Bilder in den Antworten.

Verfügbarkeit für Entwickler

Für Entwickler steht Gemini 3 Flash als Preview‑Modell gemini-3-flash-preview in der Gemini‑API und in Vertex AI bereit. Eckdaten:

- Preis: ca. 0,50 USD pro 1 Mio. Eingangstokens, 3 USD pro 1 Mio. Ausgangstokens; Audioeingaben ca. 1 USD pro 1 Mio. Tokens.

- Features: verbesserte visuelle/räumliche Reasoning‑Fähigkeiten, Agent‑/Coding‑Funktionen, Kontext‑Caching und Batch‑API für große Jobs.

Durch Kontext‑Caching und Batch‑API lassen sich bei wiederholter Kontextnutzung bis zu 50–90% Kosten einsparen, was das Modell für produktive Systeme mit vielen Anfragen interessant macht.

Was das praktisch für dich heißt

- In der Gemini‑App bekommst du automatisch Gemini 3 Flash als „Alltagsmodell“, ohne Einstellungen ändern zu müssen; für besonders anspruchsvolle Code‑/Matheaufgaben kannst du auf „Pro“ wechseln.

- Wenn du eigene Tools/Workflows baust (z.B. Skripte, Web‑Backends, Agent‑Systeme), kannst du 3 Flash über die Gemini‑API nutzen und bekommst Pro‑ähnliche Reasoning‑Qualität bei deutlich geringeren Kosten und Latenzen.

Hier findest du weiterführende Informationen: Google Blog

Ähnliche Beiträge