1000+ Fünf-Sterne-Bewertungen und Top-Auszeichnungen machen uns zu einer der gefragtesten Lernplattformen.

maschke academy blog

Wissen. Technik. Kreativität.

Der offizielle Blog der Maschke Akademie: Updates, Tutorials und Insights aus der Welt der digitalen Bildbearbeitung, KI und visuellen Medien.

Meta SAM vorgestellt

Bei „Meta SAM“

geht es aktuell vor allem um SAM 3 und SAM 3D – Metas neue Segment Anything‑Modelle, die Objekte in Bildern, Videos und sogar 3D aus beliebigen Prompts heraus erkennen und segmentieren.

Was SAM 3 kann

- SAM 3 ist ein Foundation‑Modell für „promptable segmentation“: Du kannst mit Text („das rote Auto“, „Person auf dem Pferd“) oder Klicks/Boxen arbeiten und das Modell findet und maskiert die passenden Objekte im Bild oder Video.

- Im Gegensatz zu SAM 1/2 versteht SAM 3 offene Wortschätze (open vocabulary), erkennt mehrere Instanzen gleichzeitig und trackt sie konsistent über Videoframes hinweg.

Typische Einsatzgebiete

- Datenannotation (z.B. fürs Training eigener Modelle), Bild‑/Videobearbeitung, Robotik, AR/VR, autonome Systeme, überall dort, wo du Objekte schnell und zuverlässig lokalisieren und verfolgen musst.

- In Kombination mit einem MLLM („SAM 3 Agent“) lassen sich sogar textbasierte Fragen wie „Welches Objekt wird benutzt, um ein Pferd zu lenken?“ beantworten, indem das System passende Masken iterativ findet.

SAM 3D: Von 2D zu 3D

- SAM 3D erweitert das Konzept auf 3D‑Rekonstruktion: Aus einem einzigen Foto werden 3D‑Objekte bzw. Szenen erzeugt, inklusive Form, Textur und Pose.

- Für Profis ist das momentan vor allem als schneller Entwurfsgenerator spannend (Konzept‑Modelle, AR‑Mockups), braucht aber oft noch manuelle Retopo und Feinschliff, bevor es produktionsreif ist.

Open‑Source und Zugriff

- Meta stellt SAM 3 und SAM 3D als offene Modelle mit Code auf GitHub bereit; du kannst sie lokal, im eigenen Lab oder in Pipelines (z.B. mit Ultralytics‑Wrappern) einsetzen.

- Für dich als Fotograf/Editor wäre ein typischer Workflow: Objekt‑Masken mit SAM 3 erzeugen (Freisteller, selektive Korrekturen, Video‑Masken) und diese weiter in Photoshop, After Effects oder Resolve nutzen.

Hier findest du weiterführende Informationen: AI Demos Meta

Ähnliche Beiträge

Sammlung Goetz München: Cindy Sherman

Bildbearbeitung & Fotografie

PaperVault wandelt sensible Informationen in verschlüsselte QR-Codes

Technik (Hardware & Software)

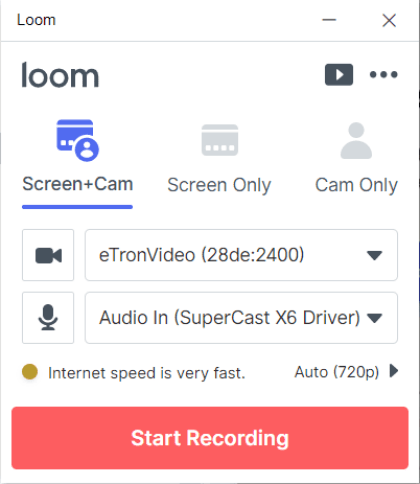

Mit Loom Bildschirm-Videos aufnehmen und teilen

Technik (Hardware & Software)

Qnap löst kritische Sicherheitsprobleme in NAS-Software

Technik (Hardware & Software)

Hol’ dir die Weiterbildung im Mail-Format

Starttermine, exklusive Rabatte und spannende Updates direkt in dein Postfach.