1000+ Fünf-Sterne-Bewertungen und Top-Auszeichnungen machen uns zu einer der gefragtesten Lernplattformen.

maschke academy blog

Wissen. Technik. Kreativität.

Der offizielle Blog der Maschke Akademie: Updates, Tutorials und Insights aus der Welt der digitalen Bildbearbeitung, KI und visuellen Medien.

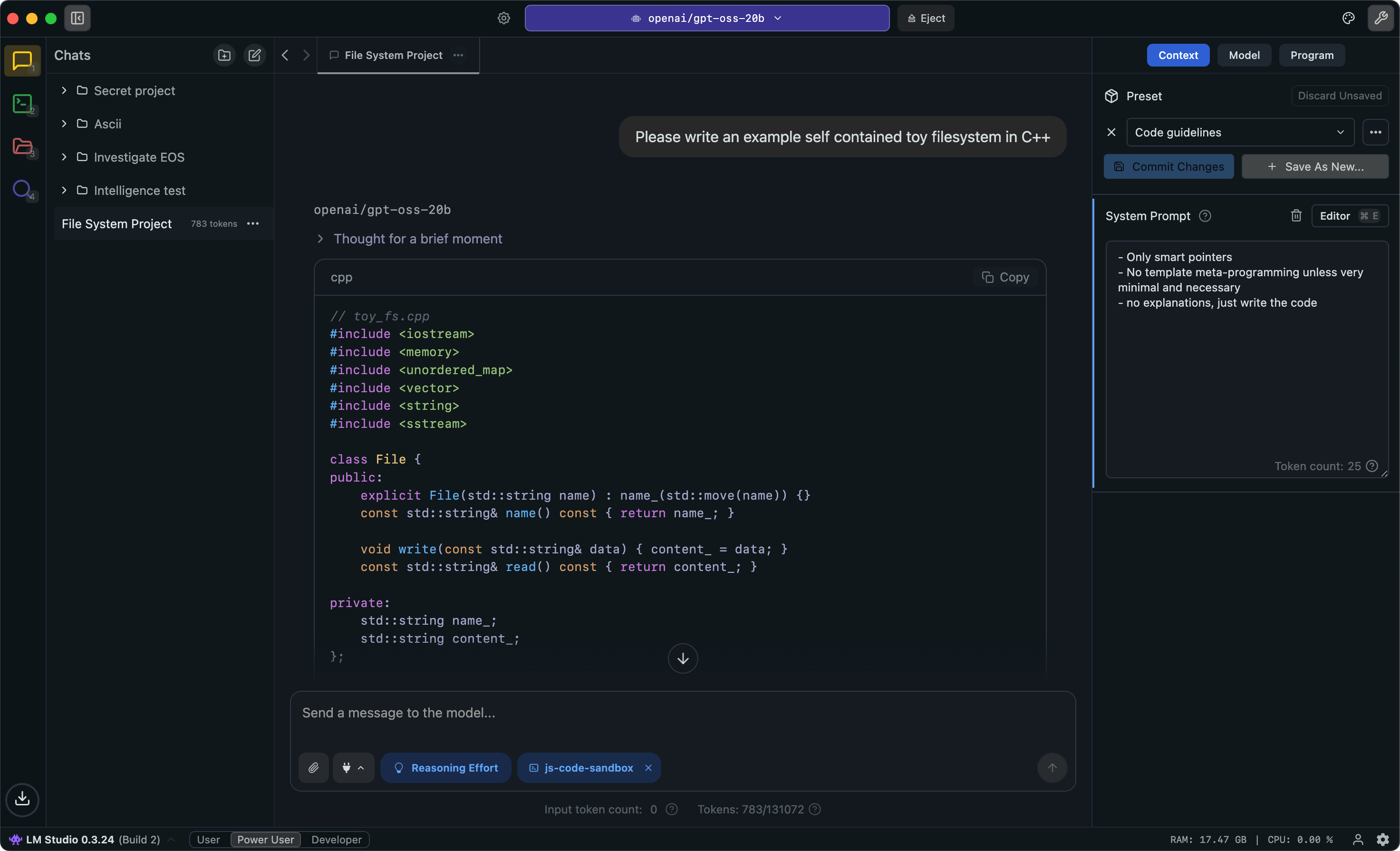

KI auf dem Rechner LM Studio der "KI-Alleskönner" mit frischer Oberfläche und neuen Funktionen

LM Studio 0.4.0

bringt eine überarbeitete Oberfläche, einen neuen Server‑Kern und zusätzliche Entwickler‑Features, bleibt aber weiterhin ein kostenloses Schweizer Taschenmesser für lokale KI‑Modelle.

Neuer Kern: Daemon-Modus und Parallelbetrieb

- Der bisher an die GUI gekoppelte Kern läuft jetzt als eigener Hintergrunddienst („llmster“), den du ohne Oberfläche auf Servern, in CI‑Pipelines oder Headless‑Setups nutzen kannst.

- Anfragen an dasselbe Modell können parallel verarbeitet werden; LM Studio bündelt Rechenoperationen („continuous batching“), sodass mehrere Chats/Clients effizienter auf ein Modell zugreifen.

Neue REST-API und Entwickler-Tools

- Eine zustandsbehaftete REST‑API erlaubt längere Dialoge, ohne jedes Mal den kompletten Verlauf zu senden; sie liefert zudem Token‑ und Latenz‑Statistiken für Monitoring und Tuning.

- Zugriffe auf den lokalen LLM‑Server lassen sich per API‑Key absichern; ein Developer Mode in der App bündelt alle Power‑User‑Optionen und zeigt Live‑Status der geladenen Modelle.

Frischere Oberfläche und bessere Bedienung

- Die UI wurde modernisiert: Chats lassen sich exportieren, mehrere Gespräche nebeneinander anzeigen, und die Modell‑Suche (inkl. Filter nach Format/Größe) wurde überarbeitet.

- Eine integrierte „Developer Docs“‑Sektion erklärt Befehle, REST‑Endpunkte und Workflows direkt in der Anwendung, was den Einstieg in eigene Integrationen erleichtert.

Einordnung für deinen Workflow

- LM Studio bleibt eine kostenlose, plattformübergreifende Lösung (macOS, Windows, Linux), mit der du Hugging‑Face‑Modelle wie Gemma, Qwen, DeepSeek & Co. lokal mit GUI oder headless betreiben kannst – ideal für datensensible Projekte oder Offline‑Einsatz.

Hier findest du weiterführende Informationen: Imstudio.ai

Ähnliche Beiträge

DigiFoto die kostenlose Windows Bildbearbeitungs-APP

Bildbearbeitung & Fotografie

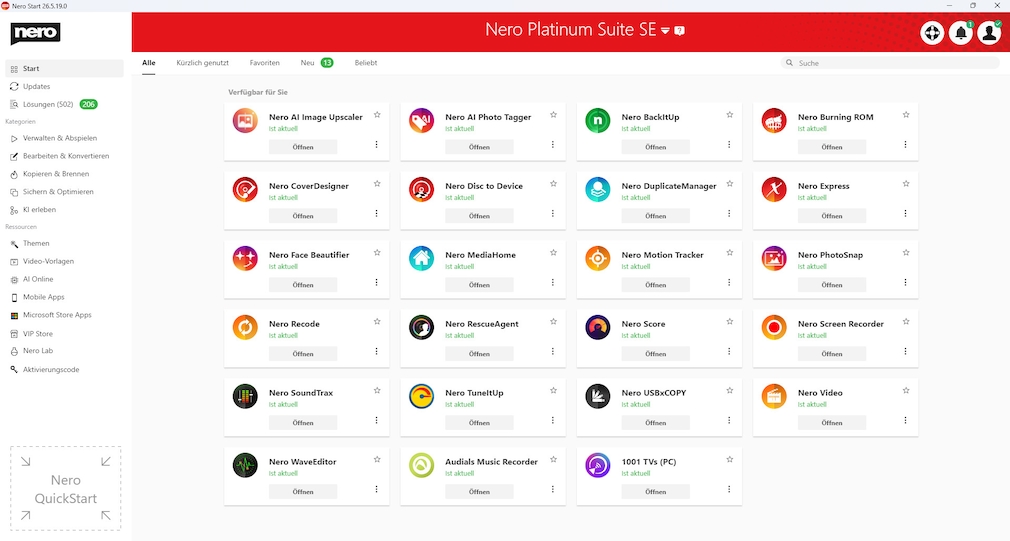

Professionelle Brennsoftware mit umfangreichen Funktionen

Nero Platinum

Technik (Hardware & Software)

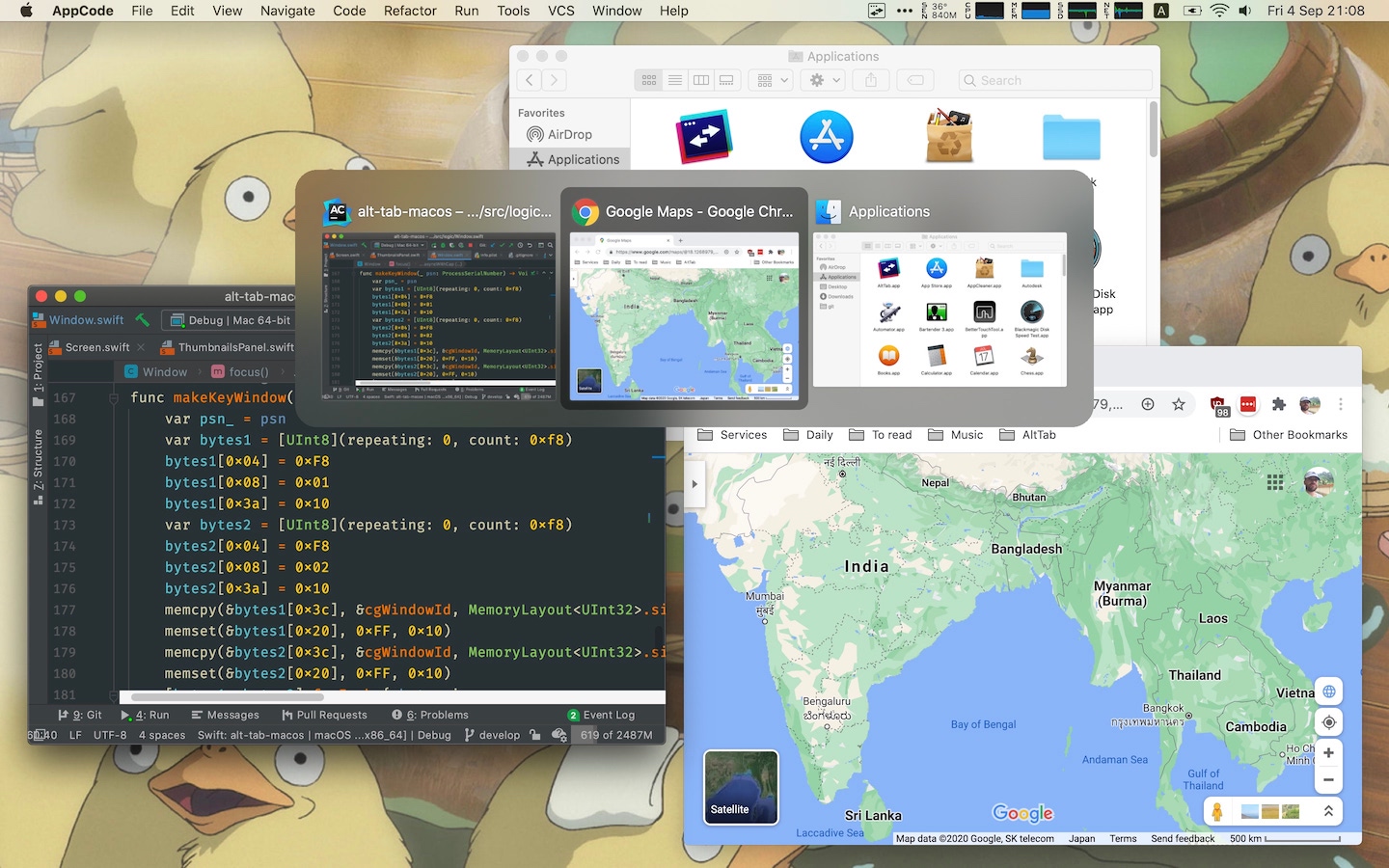

AltTab für macOS in Version 8.0: Freeware für schnellen Fensterwechsel

Technik (Hardware & Software)

Clipboard-Manager: FlowClip erweitert Maccy um Warteschlange

Technik (Hardware & Software)

Hol’ dir die Weiterbildung im Mail-Format

Starttermine, exklusive Rabatte und spannende Updates direkt in dein Postfach.