1000+ Fünf-Sterne-Bewertungen und Top-Auszeichnungen machen uns zu einer der gefragtesten Lernplattformen.

maschke academy blog

Wissen. Technik. Kreativität.

Der offizielle Blog der Maschke Akademie: Updates, Tutorials und Insights aus der Welt der digitalen Bildbearbeitung, KI und visuellen Medien.

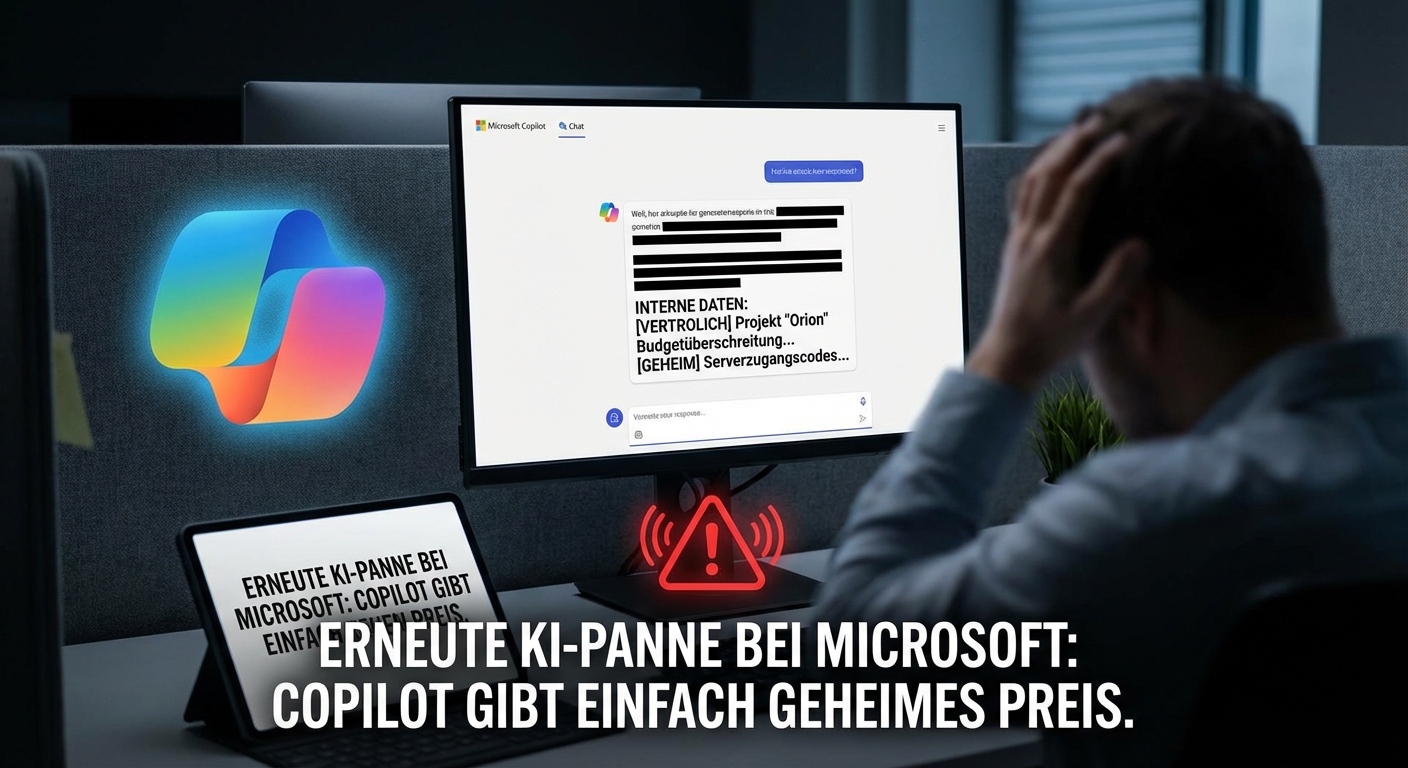

Das Risiko der KI! Microsoft Copilot sammelte vertrauliche Mails ein, obwohl er das nicht sollte

Microsoft hat einen Fehler in Microsoft 365 Copilot Chat eingeräumt, durch den der Assistent vertrauliche E‑Mails ausgewertet und zusammengefasst hat, obwohl Schutzmechanismen das eigentlich verhindern sollten.

Was genau passiert ist

- Der Bug betraf die Copilot‑Chatfunktion im „Work“-Tab von Microsoft 365 (Outlook‑Umfeld). Copilot konnte E‑Mails aus den Ordnern „Gesendet“ und „Entwürfe“ in Zusammenfassungen einbeziehen, obwohl diese mit Vertraulichkeits‑Labels gekennzeichnet und durch Data‑Loss‑Prevention‑Richtlinien (DLP) geschützt waren.

- Intern wird der Vorfall unter der Kennung CW1226324 geführt; erste Hinweise von Kunden gab es am 21. Januar 2026.

Ursache und Reaktion von Microsoft

- Auslöser war laut Microsoft ein Programmierfehler in der Copilot‑Chatlogik, der dazu führte, dass die DLP‑ und Sensitivity‑Labels in dieser speziellen Funktion nicht korrekt beachtet wurden.

- Microsoft hat Anfang Februar einen Fix ausgerollt und überwacht dessen Verteilung; ein Teil der betroffenen Unternehmenskunden wird gezielt informiert, während Admins angehalten sind, das Verhalten in ihren Tenants zu prüfen.

Was Admins jetzt tun sollten

- In den Admin‑Portalen prüfen, ob die Service‑Hinweise zu CW1226324 angezeigt werden, und kontrollieren, ob Copilot‑Chat sich nun konform zu den DLP‑Richtlinien verhält.

- Audit‑Logs und Zugriffsprotokolle analysieren, um festzustellen, ob und in welchem Umfang vertrauliche E‑Mails im relevanten Zeitraum von Copilot verarbeitet wurden. Bei Bedarf interne Meldungen (Compliance/DSB) und zusätzliche Schutzmaßnahmen (z. B. Einschränkung von Copilot‑Funktionen, „Restricted Content“-Policies) umsetzen.

Hier findest du weiterführende Informationen: Winfuture

Ähnliche Beiträge

Ollama Download:

KI-Sprachmodelle auch lokal verwenden

Künstliche Intelligenz

Microsoft Copilot Studio für KI-Agenten.

Künstliche Intelligenz

Für alle Google Workspace Besitzer! Google Drive: Automatisch generierte Video-Untertitel jetzt auch in deutscher Sprache

Technik (Hardware & Software)

Light Image Resizer für Windows vorgestellt

Bildbearbeitung & Fotografie

Hol’ dir die Weiterbildung im Mail-Format

Starttermine, exklusive Rabatte und spannende Updates direkt in dein Postfach.